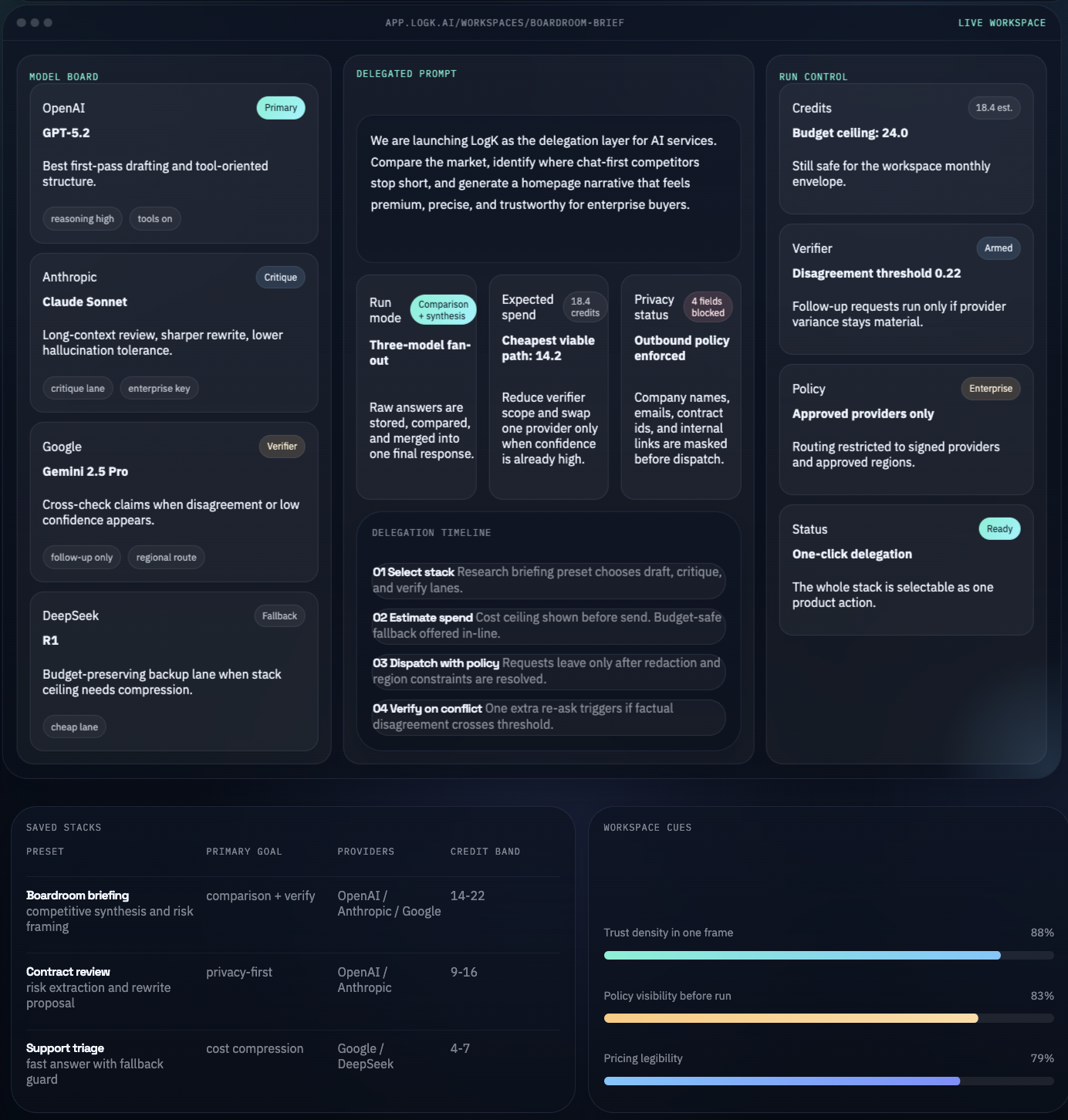

하나의 대시보드에서 여러 모델을 선택합니다

사용자는 하나의 모델만 고를 수도 있고, 여러 모델 카드를 함께 선택해 비교, 집계, 혹은 작업별 최적 조합을 구성할 수도 있습니다.

- 프로바이더, 속도, 품질, 모달리티별 모델 카드

- 여러 답변을 한 번에 비교

- 현재 질문에 맞는 추천 스택 제공

멀티모델 AI 위임

LogK는 ChatGPT, Claude, Gemini 같은 여러 AI 모델을 하나의 대시보드에서 함께 선택하고, 예상 비용을 먼저 확인한 뒤, 질문을 위임하고, 결과를 비교하거나 집계할 수 있게 합니다.

실행 중인 워크스페이스 예상 비용 18.4 credits

실행 중인 워크스페이스 예상 비용 18.4 credits 홈페이지 첫 화면에서 제품이 추상적인 설명이 아니라 실제 소프트웨어처럼 보이도록 바꿉니다.

솔루션

현재 시장의 많은 제품은 개발자 게이트웨이, 단일 채팅 인터페이스, 혹은 관측성에 집중합니다. LogK는 그 위에서 사용자가 모델을 고르고, 가격을 보고, 위임하고, 검증하는 의사결정 레이어를 만듭니다.

사용자는 하나의 모델만 고를 수도 있고, 여러 모델 카드를 함께 선택해 비교, 집계, 혹은 작업별 최적 조합을 구성할 수도 있습니다.

LogK는 요청 실행 전에 예상 비용을 보여주어, 사용자가 가격과 품질, 범위 사이에서 의도적인 선택을 할 수 있게 합니다.

모델 간 의견이 갈리거나 신뢰도가 낮을 때, 혹은 한 번 더 확인이 필요할 때 자동으로 후속 질문과 검증 루프를 실행할 수 있습니다.

제품 인터페이스

작업 흐름은 분명합니다. 모델 스택을 고르고, 여러 프로바이더에 위임하고, 마지막으로 결과를 비교하고 검증합니다.

빠른 응답이 필요하면 한 모델을, 비교가 필요하면 여러 모델을, 그리고 글쓰기나 코딩, 리서치처럼 작업 특성이 분명하면 추천 스택을 선택할 수 있습니다.

LogK는 선택된 모델들로 요청을 fan-out하고, 비용을 중앙에서 추적하며, 프로바이더와 후속 단계가 달라도 전체 실행 흐름을 일관되게 유지합니다.

한 모델의 답을 그대로 믿게 하지 않고, 모델 간 차이와 신뢰도 격차, 검증 패스를 보여주어 더 믿을 수 있는 결론에 도달하게 합니다.

프로바이더 간 불일치를 집계 전에 표시

신뢰도가 낮을 때 verifier 프롬프트 실행

모델 추적 정보와 함께 최종 집계 답변 생성

기술

이 시스템은 단순한 모델 스위처가 아닙니다. 사용자가 더 좋은 모델을 선택하고, 크레딧 비용을 관리하며, 민감한 문맥을 안전하지 않은 경로로 보내지 않도록 돕는 라우팅 및 의사결정 레이어입니다.

질문이 프로바이더로 나가기 전에, 후보 모델 스택, 개인정보 정책, 예상 비용, 검증 단계까지 먼저 계산합니다.

현재 프롬프트에 맞는 모델 혹은 모델 스택을 추천하고, 가격, 품질, 가용성, 워크플로 프리셋에 따라 요청을 라우팅합니다.

위임 전에 가림 처리나 차단 규칙을 적용하고, 크레딧 기반 과금을 실행 단위, 팀 단위, 계정 단위로 계속 보이게 유지합니다.

회사 소개

모델은 계속 늘어나지만 사용자의 실제 워크플로는 더 파편화되고 있습니다. LogK는 많은 AI 서비스를 더 경제적이고, 일관되고, 믿을 수 있게 사용하는 방식을 만들고자 합니다.

사용자는 최고의 답을 얻기 위해 여러 탭을 열고 수동 복사-붙여넣기를 반복할 필요가 없어야 합니다.

시장은 이미 개발자 게이트웨이와 관측성 도구를 가지고 있습니다. LogK는 사용자-facing 레이어, 즉 모델 선택, 위임 UX, 답변 비교, 신뢰에 집중합니다.

문의

LogK는 여러 모델 사이로 질문을 위임하고, 비용을 먼저 확인하고, 개인정보를 통제하며, 더 신뢰할 수 있는 결과를 얻고 싶은 팀과 고급 사용자들을 위해 설계되었습니다.